Efecto Moiré típico en fotografía de tejidos. Foto: Camilo Rueda López (CC BY-ND 2.0)

El filtro óptico paso bajo (OLPF – Optical Low-Pass Filter) se coloca en el sensor para evitar o minimizar los efectos de aliasing (por ejemplo el efecto Moiré -pronunciado muaré) que se producen al convertir la imagen continua del mundo real en una imagen digital discreta formada por puntos.

La imagen real de cualquier escena está formada por infinitos puntos. Como vimos en el artículo sobre el funcionamiento del sensor electrónico, el sensor hace un muestreo de la escena, de tal forma que cada píxel recoge una muestra (luz-color) de la zona de imagen que le corresponde.

Cuando se hace un muestreo siempre hay cierta pérdida de información. Además, si la frecuencia de muestreo no es lo suficientemente alta se produce un efecto conocido como aliasing.

El aliasing en las imágenes consiste en que la imagen resultante del muestreo presenta patrones de interferencia: en lugar de mostrar por ejemplo líneas paralelas aparecen ondas, efectos visuales o artefactos de color que no existen en la imagen real. Esos elementos son ‘alias’ o fantasmas que forman parte de la información (incompleta) de alta frecuencia de la imagen original.

¿Qué es eso de la frecuencia en una escena y la frecuencia de muestreo?

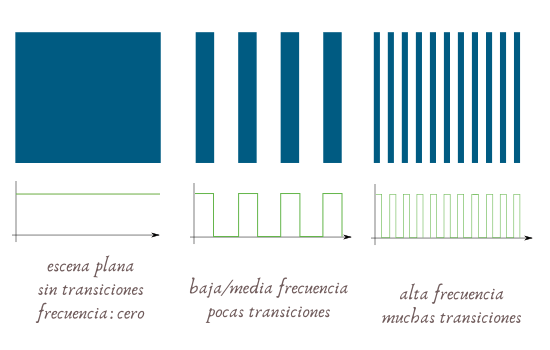

Imagina que queremos fotografiar una escena totalmente plana, de un único tono de color, perfectamente continua. En esa escena la frecuencia espacial es cero, no hay cambios ni transiciones (de luz o de color) a lo largo y ancho de la misma.

Cuando hablamos de frecuencia espacial nos referimos a que se trata de las transiciones en cualquier dirección (horizontal, vertical, diagonal..) en las dos dimensiones espaciales de una imagen.

Imagina ahora que queremos fotografiar una camisa a rayas verticales muy finas y juntas. Cuando recorremos la imagen de izquierda a derecha vemos que la frecuencia espacial es muy alta, hay muchas transiciones de luz-color por unidad de espacio y además es un patrón repetitivo.

En una escena normal habrá zonas con frecuencia espacial baja y zonas con frecuencia espacial alta. Habitualmente las escenas de muy alta frecuencia espacial corresponden con objetos fabricados por el hombre, que contienen muchas líneas paralelas o patrones regulares: camisas a rayas, rejas, pared de ladrillos, tejidos.. En la naturaleza, quizás en fotografía macro se pueden dar escenas de alta frecuencia espacial, cuando entramos en detalles de plantas, animales, etc. que pueden tener patrones repetitivos y/o fractales. En el caso de fotografía de aves también puede aparecer algo de Moiré en el plumaje.

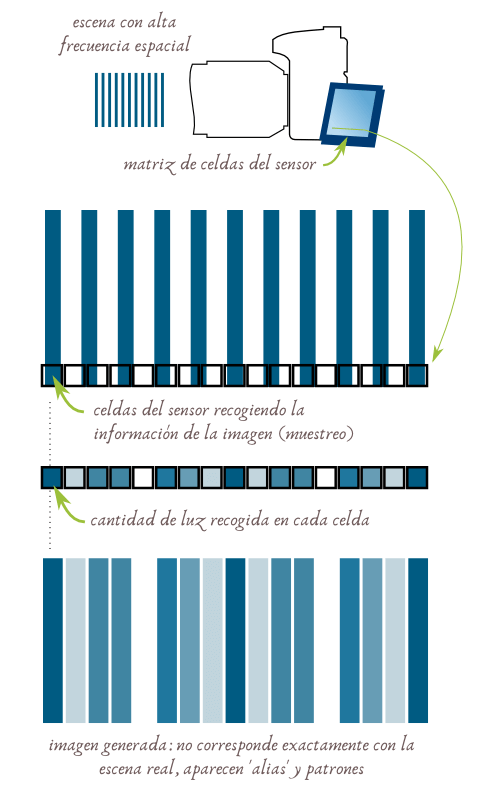

Ahora vamos a la parte del muestreo. El sensor está formado por una matriz de puntos que tiene por tanto una frecuencia espacial determinada. Cuanto mayor es la resolución del sensor mayor es la frecuencia espacial de muestreo de dicho sensor.

Si fotografiamos una escena que contiene zonas con una frecuencia espacial más alta que la de muestreo se producirá efecto aliasing.

En un sensor real cada celda recoge información de uno de los tres colores básicos: rojo, verde, azul. Y esta distribución de colores (color asignado a cada celda) sigue un patrón especial llamado mosaico de Bayer. Pero para verlo en un ejemplo sencillo vamos a suponer que nuestro sensor trabaja en blanco y negro. Tenemos una escena con una alta frecuencia espacial y un sensor con una determinada resolución que no cumple el criterio de muestreo:

La imagen generada en este caso no se corresponde con la escena. Las barras verticales se han transformado en una secuencia que sigue un patrón diferente al de la escena. Un sensor real, debido al mosaico de Bayer, generaría además colores ficticios que no aparecen en los objetos que estamos fotografiando.

Cuando esto ocurre, la imagen final ha perdido parte de la información y no es posible recuperar a posteriori esa información perdida, aunque se pueden utilizar técnicas para reconstruir, minimizar o disimular los efectos del aliasing.

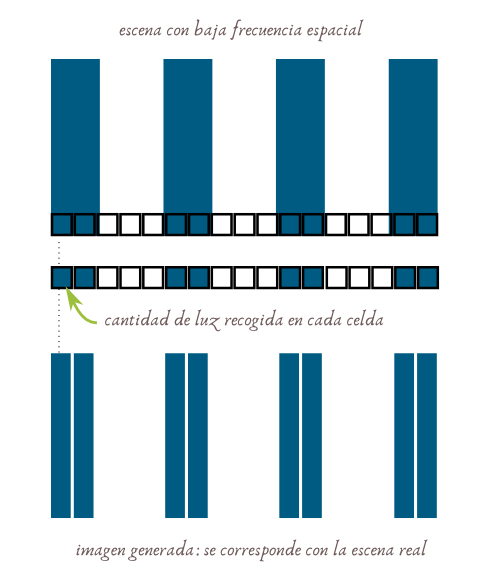

Para las escenas con frecuencia espacial más baja, la resolución del sensor cumplirá el criterio de muestreo y la imagen resultante seguirá el mismo patrón que la escena real:

¿Cuándo y cómo se nota el efecto de aliasing?

Estos efectos se notan sobre todo cuando fotografiamos escenas con zonas de alta frecuencia espacial que además sean repetitivas a lo largo de un área apreciable. Es decir, en una imagen normal los posibles efectos de aliasing quedan camuflados a menos que se trate de un área suficientemente grande.

Si el área de alta frecuencia es extensa (y se cumplen ciertas relaciones entre la frecuencia de muestreo y la frecuencia de la escena) entonces sí serán apreciables los efectos. Los más típicos son los patrones de Moiré y los artefactos de color.

¿Cómo se pueden evitar estos efectos?

La única forma de evitar el aliasing es haciendo que la frecuencia de muestreo sea mayor que la frecuencia espacial de la escena (por encima del doble según el teorema de muestreo)

Se puede aumentar la resolución del sensor (más megapíxels) o se puede limitar la frecuencia espacial máxima de la escena.

Los sensores han ido aumentando progresivamente su resolución, con lo que su frecuencia de muestreo espacial es cada vez más alta, y la posibilidad de generar aliasing es más baja.

La otra opción, limitar la frecuencia máxima de la escena, se consigue mediante el filtro óptico paso bajo (OLPF). En general estos filtros reciben el nombre de filtros anti-aliasing (AA filters)

Un filtro paso bajo es aquél que deja pasar la información de baja frecuencia y bloquea (no deja pasar) la información de alta frecuencia.

Lo que hacen los filtros OLPF es precisamente eso: eliminan la información de muy alta frecuencia de la imagen. Son filtros ópticos, no electrónicos, trabajan directamente sobre la luz de la escena antes de que llegue al sensor.

Hay que tener en cuenta que una vez que se produce aliasing es imposible recuperar la información original. Dicho de otra forma, es muy difícil eliminar o reducir el efecto Moiré una vez que se ha generado la imagen en el sensor, se puede disimular o reducir utilizando algunas técnicas en la fase de edición, pero nunca se recupera la imagen exacta de la escena (esa información se ha perdido en el proceso de muestreo). Por eso el filtro OLPF es importante y la mayoría de los sensores lo han incorporado hasta hace relativamente poco.

Pros y contras del filtro OLPF

El principal problema del filtro OLPF es que al filtrar las altas frecuencias se pierde nitidez en la imagen resultante.

Las altas frecuencias de una imagen son los detalles, el contraste entre un elemento de la imagen y otro, la definición de los contornos de los objetos..

Eliminar las altas frecuencias equivale a suavizar la imagen, hacer un poco más difusas las transiciones, los contornos..

El filtro OLPF se diseña para cada sensor como un compromiso: minimizar los efectos más visibles de aliasing sin que afecte demasiado a la nitidez.

Dicho de otra forma, ni todos los filtros OLPF son iguales, ni afectan de igual forma a todos los sensores, ni producen el mismo resultado final. Cada fabricante decide para cada modelo en concreto las características del filtro.

Quizás el principal inconveniente del filtro OLPF es que se aplica siempre, independientemente de si la escena lo necesita o no. Es decir, los efectos negativos del filtro afectan a todas las imágenes, mientras que los efectos positivos sólo afectarán a unas pocas imágenes en las que se puede generar aliasing visible.

También hay que decir que la pérdida de nitidez se puede corregir bastante bien en la fase de edición (ajustando contraste, curvas, etc.) mientras que los patrones de Moiré son muy difíciles de eliminar.

Algunos modelos de cámaras dan prioridad a la eliminación de efecto Moiré, incorporando al sensor un filtro OLPF más agresivo. Otros modelos dan prioridad a la nitidez, colocando un filtro OLPF muy suave (sólo filtra las muy muy altas frecuencias) o directamente eliminando el filtro.

Por ejemplo, la Nikon D5200 incorpora un filtro OLPF relativamente agresivo para minimizar Moiré. Como el sensor tiene una resolución grande (24Mp) se nota más la ligera pérdida de nitidez cuando se analiza la imagen al detalle.

El siguiente modelo de su gama, la Nikon D5300, ya no incorpora filtro OLPF. Da prioridad a la nitidez a costa de aumentar el riesgo de aliasing en algunas fotografías.

Otro ejemplo de Nikon en las gamas altas son los modelos D800 (con filtro OLPF) y D800e (sin filtro OLPF). Estos sensores son de 36Mp con lo que sí puede ser apreciable la diferencia de nitidez, sobre todo analizando píxel a píxel.

En el caso de Canon por ejemplo la EOS 700D y la EOS 7D tienen el mismo sensor pero la 7D incluye un filtro OLPF más agresivo. Como la resolución del sensor es más baja que en las Nikon anteriores (18Mp) el efecto en la 700D es inapreciable en cuanto a nitidez, mientras que en la 7D sí se nota cierta pérdida de contraste con respecto a la 700D.

Ten en cuenta que el objetivo de la cámara ya hace un efecto de filtro paso bajo, de suavizado. Este efecto depende de la calidad óptica del objetivo y de la apertura a la que estemos trabajando con él. El problema de la pérdida de nitidez debida al filtro OLPF normalmente se aprecia con objetivos de gama media /alta. Con objetivos de menor calidad óptica, el efecto de suavizado del propio objetivo normalmente es mayor que el efecto del filtro OLPF (dependerá de la combinación de objetivo + filtro OLPF + resolución del sensor).

En los sensores con mayor resolución la probabilidad de aliasing es menor. Y precisamente en los sensores con mayor resolución es donde más se puede apreciar el efecto de pérdida de nitidez.

Entonces, ¿es bueno o malo que el sensor tenga filtro OLPF?

Como decimos siempre: todas estas cámaras, tengan o no filtro OLPF, ofrecen una calidad de imagen impresionante y cuando hablamos de pérdida de nitidez es a un nivel de detalle que no vamos a necesitar en condiciones normales

El efecto de pérdida de nitidez debido al filtro OLPF estará normalmente por debajo del efecto de pérdida de nitidez debido a la óptica. En general sólo lo notaremos usando objetivos de alta calidad y analizando las imágenes píxel a píxel. Y la pérdida de nitidez se puede corregir en la fase de edición.

Para un usuario aficionado, incluso semi profesional, esta característica no es importante (en lo que respecta a la nitidez) en el 99.9% de los casos.

Para un fotógrafo profesional, tendrá que valorar si le interesa más minimizar el efecto Moiré (p.e. en retrato, fotografía de bodas, moda, etc. muchos vestidos pueden dar lugar a aliasing visible, fotógrafos relacionados con arquitectura..) o por el contrario prefiere tener la máxima nitidez posible que le permitan el sensor (p.e. fotógrafos de naturaleza, paisajes, etc. que raramente encontrarán escenas con patrones repetitivos de alta frecuencia) y sus objetivos de gama alta.

La tendencia probablemente en el futuro es eliminar el filtro o incluir filtros paso bajo muy suaves ya que los sensores cada vez tienen más resolución. Y probablemente aplicar técnicas de reducción de aliasing en el procesador interno de la cámara. También se habla de filtros OLPF que se puedan activar o desactivar a voluntad, quizás en el futuro aparezca alguna cámara con esta innovación.

La realidad es que el balance entre pros y contras suele estar bastante equilibrado en la mayoría de los modelos de cámaras.

¿Con el filtro OLPF se elimina definitivamente el efecto Moiré?

No.

El filtro (dependiendo de lo agresivo que sea) disminuye el riesgo de que aparezcan patrones de Moiré en la imagen resultante. Puede haber casos concretos en los que aparezca Moiré incluso con filtros OLPF agresivos.

Además hay que tener en cuenta que si redimensionamos la imagen (por ejemplo para utilizarla en una web) el proceso al redimensionar es equivalente a un muestreo. Muchas veces vemos una imagen sin efecto Moiré a un determinado tamaño y cuando redimensionamos aparecen los patrones de aliasing.

Moiré en vídeo

Cada frame (fotograma) de vídeo tiene una resolución mucho menor que la imagen que proporciona el sensor para fotografía. El procesador de la cámara se encarga de hacer un muestreo (interpolación /diezmado) a partir de la información del sensor para generar cada frame.

Por lo tanto, la frecuencia espacial de muestreo efectiva es más baja en vídeo y el riesgo de que aparezcan patrones de Moiré es mayor en grabación de vídeo que en fotografía para un determinado sensor. Además suele ser más molesto porque se forman patrones de interferencia en movimiento.

Más información sobre el funcionamiento del sensor de una cámara